https://tech.kakaoenterprise.com/196 를 보고 요약 및 생각 정리한 게시글입니다.

검정 글씨 : 요약, 원문 / 파란 글씨 : 내 생각

FMOps란?

MLOps에 이어 새롭게 등장하고 떠오르고 있는 기반 모델, 그중에서도 특히 LLM 기반의 앱 개발을 위한 방법론

※ LLMOps가 아닌 FMOps라는 표현을 선택하여 사용하는 이유는? LLMOps는 자연어 처리 분야에만 국한되는 기반 모델을 칭하는 용어인 LLM이 포함된 반면 FMOps는 자연어 처리를 포함한 이미지, 음성 등 더욱 다양한 모달리티의 기반 모델들 (예: DALL-E) 을 포함하여 해당 용어를 사용하게 되었습니다. 하지만 현재 시장에서는 기반 모델 중에서도 LLM을 활용하여 앱을 개발하는 것에 관심이 몰려있기 때문에 두 용어는 현재 혼재되어 사용

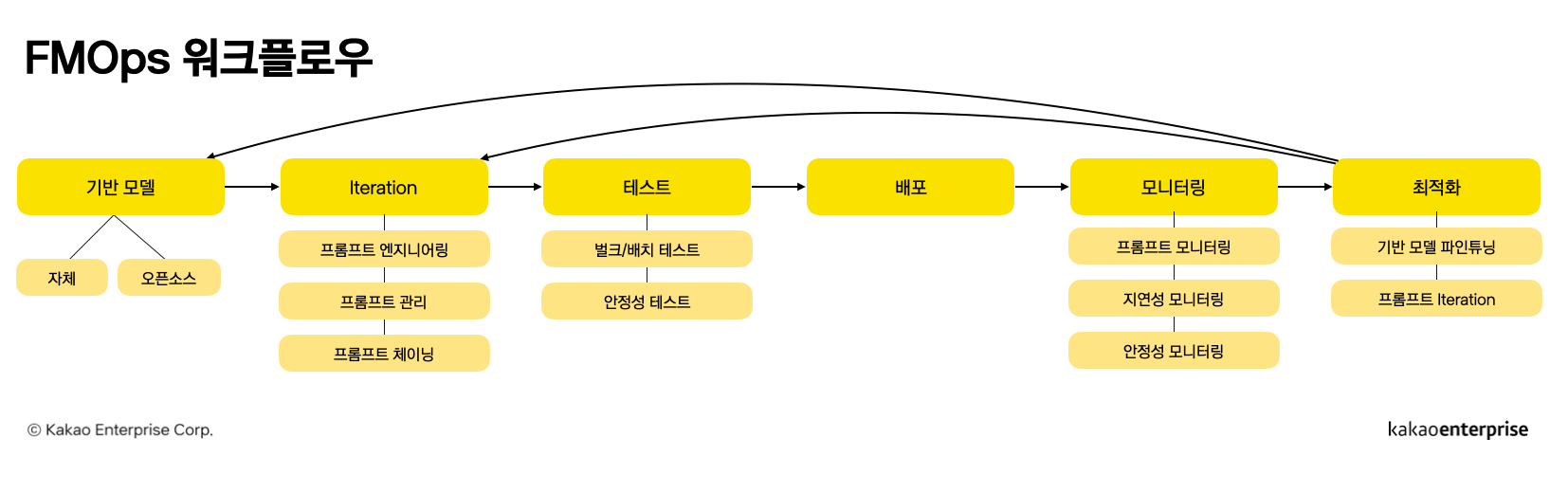

FMOps 워크플로우와 핵심 기술 요소들

FMOps에서는 기본적으로 반복적인 프롬프트 엔지니어링을 통해 기반 모델의 답변 성능을 향상

하지만 프롬프팅만으로 기반 모델 답변 향상에 한계가 있거나, 토큰 소비량이나 답변 지연성을 대폭 줄여야 한다고 판단 -> 파인튜닝이 필요합니다.

파인튜닝의 방식은 다양하지만, 기존에 특정 태스크 데이터를 기반으로 학습된 기반 모델에 특정 도메인이나 내용의 질문에 답변을 더욱 잘할 수 있도록 사용자의 특정 데이터를 추가로 주입하는 전이 학습 (Transfer Learning) 방식이 FMOps에서 가장 대표적으로 사용되고 있습니다.

MLOps와는 무엇이 다른가?

사용자가 MLOps와 FMOps 플랫폼에서 각각 모델을 어떻게 다루는지, 주요 차이점을 중심으로 표로 정리해 보았습니다.

MLOps가 AI 모델의 개발, 배포, 최적화를 위한 플랫폼 ( 개발까지 이어지는 과정의 최적화 )

FMOps는 이미 학습을 마치고 배포된 모델과 자사 또는 자신의 데이터를 결합하여 커스텀한 LLM 기반 AI 앱을 만드는 것

내부 LLM학습 시스템 구축에 어려움을 겪는 학부생입장으로는 FMOps를 활용해서,

이미 존재하는 기반모델 LLM(GPT, Claude등) 의 API를 활용하고 다른 모델과 연결하여 커스텀한 '서비스'를 만드는것이 더 유용해보인다.

물론 그과정에서 프롬프트 엔지니어링으로 성능개선의 한계가 있을 때는

1. RAG 등 내부데이터를 보강하여 데이터의 신뢰성을 높이는 것

2. 파인튜닝을 통해 데이터의 성능을 높이는 것

이 2가지에 집중해야한다고 본다. 기존의 하이퍼 파라미터 튜닝 등을 통해 모델성능을 높이던 것과 달리,

1) sllm 튜닝 기법 (PEFT 등) 2)도메인 특화 데이터 셋(커스텀 데이터셋) 3) 프롬프트 엔지니어링이 모델 성능강화에 핵심적인 역할을 하게 될 것으로 보인다.

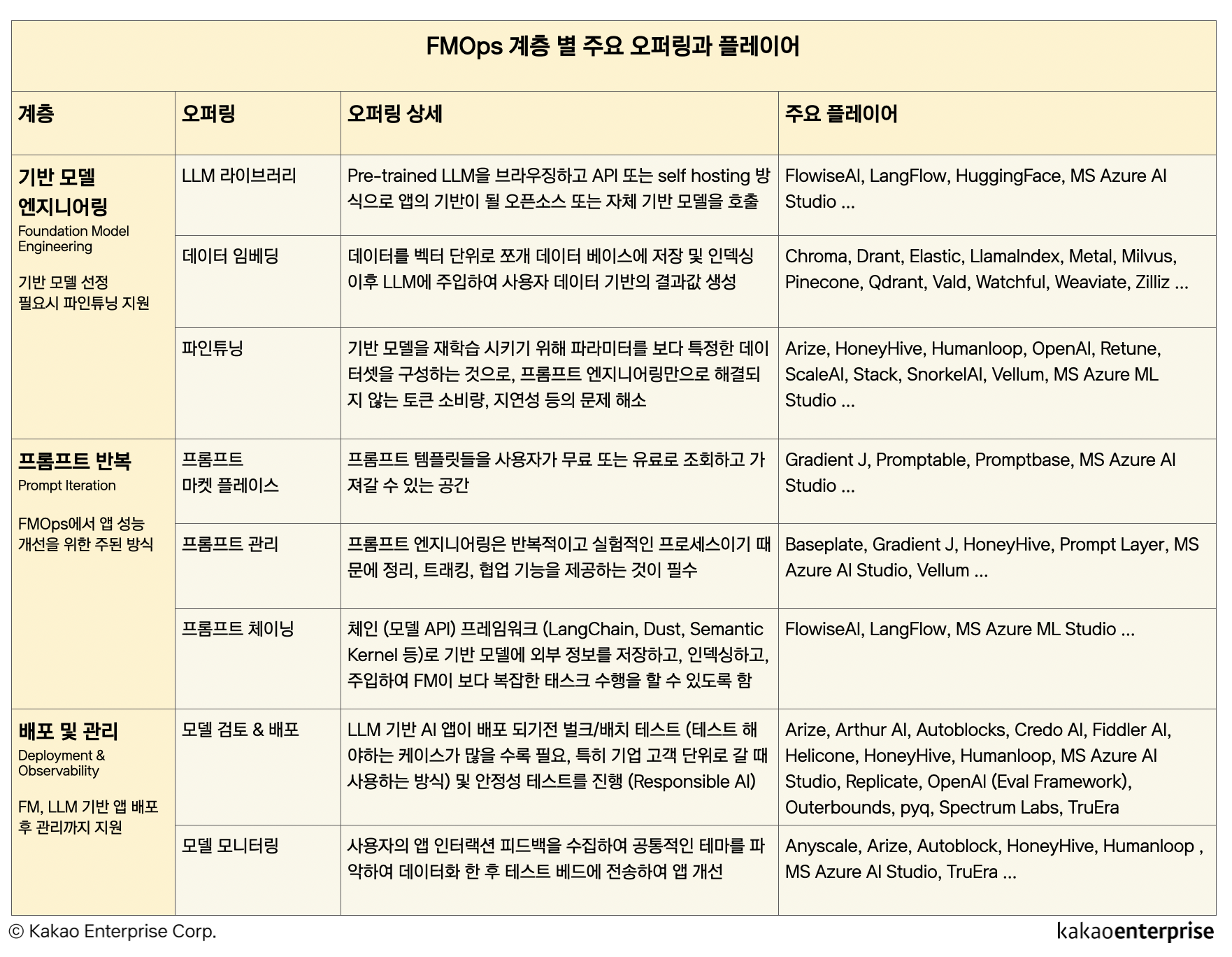

FMOps 주요 오퍼링과 플레이어들

아래는 FMOps 플랫폼이 계층별로 어떤 주된 기능들을 제공하는지 표로 정리해 본 것입니다.

FMOps의 사전적 정의는 ‘방법론'이지만 이를 전체적으로, 또는 부분적으로 지원하기 위한 서비스와 플랫폼이 제공되고 있습니다. .

- FMOps의 기능 일부를 제공하는 주요 플레이어

- 최근에는 MS가 같이 모든 계층의 오퍼링을 아우르는, 엔드 투 엔드 플랫폼을 제공

앱 개선에 대한 엔드 투 엔드 방식을 사용하낟는 점에서 MS Azure AI Studio의 활용성이 높을 것으로 예상된다.

또한 RAG 방법론에 대한 교육, Azure 전반에 대한 교육을 무료로 진행하고 , 학생 요금제를 운용한다는 점에서 생각보다 접근성이좋은 듯, 파인튜닝 방법에 대해서도 찾아봐야 겠다.

1. 기반 모델 엔지니어링(Huggingface - MS Azure AI Studio)

- 데이터 임베딩(LlamaIndex, Milcus, Pinecone)

- Prompt 구성

2. 배포 및 관리(모델 모니터링 - MS Azure AI Studio)

'Data Science > 📝 논문리뷰' 카테고리의 다른 글

| [논문리뷰/NLP] ARAGOG: Advanced RAG Output Grading(2024) (0) | 2025.01.26 |

|---|---|

| [Fintech Trend]1초만에 간편결제, 임베디드 금융이란 무엇인가? (2) | 2024.11.20 |

| [논문리뷰/NLP] Adapting Large Language Models to Domains via Reading Comprehension (7) | 2024.09.30 |

| [논문리뷰/CV] YOLO(You Only Look Once: Unified, Real-Time Object Detection) (1) | 2024.04.14 |

| [논문리뷰/CV] Faster R-CNN 모델 (R-CNN, Fast R-CNN과 비교) (0) | 2024.04.04 |